- Power BI forums

- Updates

- News & Announcements

- Get Help with Power BI

- Desktop

- Service

- Report Server

- Power Query

- Mobile Apps

- Developer

- DAX Commands and Tips

- Custom Visuals Development Discussion

- Health and Life Sciences

- Power BI Spanish forums

- Translated Spanish Desktop

- Power Platform Integration - Better Together!

- Power Platform Integrations (Read-only)

- Power Platform and Dynamics 365 Integrations (Read-only)

- Training and Consulting

- Instructor Led Training

- Dashboard in a Day for Women, by Women

- Galleries

- Community Connections & How-To Videos

- COVID-19 Data Stories Gallery

- Themes Gallery

- Data Stories Gallery

- R Script Showcase

- Webinars and Video Gallery

- Quick Measures Gallery

- 2021 MSBizAppsSummit Gallery

- 2020 MSBizAppsSummit Gallery

- 2019 MSBizAppsSummit Gallery

- Events

- Ideas

- Custom Visuals Ideas

- Issues

- Issues

- Events

- Upcoming Events

- Community Blog

- Power BI Community Blog

- Custom Visuals Community Blog

- Community Support

- Community Accounts & Registration

- Using the Community

- Community Feedback

Register now to learn Fabric in free live sessions led by the best Microsoft experts. From Apr 16 to May 9, in English and Spanish.

- Power BI forums

- Power BI Spanish forums

- Translated Spanish Desktop

- Re: No se puede importar un conjunto de datos gran...

- Subscribe to RSS Feed

- Mark Topic as New

- Mark Topic as Read

- Float this Topic for Current User

- Bookmark

- Subscribe

- Printer Friendly Page

- Mark as New

- Bookmark

- Subscribe

- Mute

- Subscribe to RSS Feed

- Permalink

- Report Inappropriate Content

No se puede importar un conjunto de datos grande en el escritorio y el servicio con conexión ODBC

Hola comunidad,

Me enfrento a un problema. Tengo un conjunto de datos de aproximadamente 200 + M filas, que crece en millones de filas diarias, y no puedo importar los datos en Desktop para crear un conjunto de datos allí, o en Service para crear un Dataflow o Datamart.

Estoy utilizando una conexión ODBC a una base de datos de Amazon Redshift.

En el escritorio, los datos nunca se cargan o, al intentar transformar los datos, la evaluación nunca termina en Power Query. Lo mismo en Service, cuando se intenta crear un Dataflow o Datamart, la evaluación se cancela en Power Query al alcanzar el límite de 10 minutos. Luego, cuando hago clic en guardar, obtengo un error de "Error de evaluación de PQO".

¿Hay alguna sugerencia sobre cómo tratar este problema?

Solved! Go to Solution.

- Mark as New

- Bookmark

- Subscribe

- Mute

- Subscribe to RSS Feed

- Permalink

- Report Inappropriate Content

He creado un archivo pbix filtrado que solo tiene una instantánea de los datos. Configure la actualización incremental en él. Publicado y actualizado. Eso creó las particiones.

A continuación, debe usar herramientas externas como SQL Management Studio y XML Toolkit para quitar el filtrado y actualizar las particiones.

Mira este video:

https://youtu.be/5AWt6ijJG94

Otra forma es crear un parámetro para filtrar los datos y cambiarlos o quitarlos de la configuración del conjunto de datos en el servicio Power BI.

- Mark as New

- Bookmark

- Subscribe

- Mute

- Subscribe to RSS Feed

- Permalink

- Report Inappropriate Content

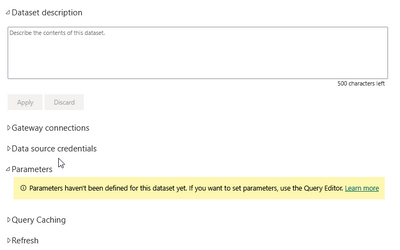

Si crea un parámetro de fecha en Power Query y filtra los datos según él, cuando se publique el informe podrá ver el parámetro aquí y cambiar su valor:

- Mark as New

- Bookmark

- Subscribe

- Mute

- Subscribe to RSS Feed

- Permalink

- Report Inappropriate Content

¿Puede explicar esto en detalle, por favor?

Otra forma es crear un parámetro para filtrar los datos y cambiarlos o quitarlos de la configuración del conjunto de datos en el servicio Power BI.

¿Desde dónde quitar el filtro en el servicio Power BI?

- Mark as New

- Bookmark

- Subscribe

- Mute

- Subscribe to RSS Feed

- Permalink

- Report Inappropriate Content

Gracias por su respuesta. Utilizamos la licencia profesional, por lo tanto, esto no funcionará en nuestro caso.

De todos modos, gracias por su pronta respuesta.

- Mark as New

- Bookmark

- Subscribe

- Mute

- Subscribe to RSS Feed

- Permalink

- Report Inappropriate Content

He creado un archivo pbix filtrado que solo tiene una instantánea de los datos. Configure la actualización incremental en él. Publicado y actualizado. Eso creó las particiones.

A continuación, debe usar herramientas externas como SQL Management Studio y XML Toolkit para quitar el filtrado y actualizar las particiones.

Mira este video:

https://youtu.be/5AWt6ijJG94

Otra forma es crear un parámetro para filtrar los datos y cambiarlos o quitarlos de la configuración del conjunto de datos en el servicio Power BI.

- Mark as New

- Bookmark

- Subscribe

- Mute

- Subscribe to RSS Feed

- Permalink

- Report Inappropriate Content

Hola, ¿encontró la solución a este problema, también me enfrento al mismo problema al importar grandes conjuntos de datos en Power BI en el nivel inicial?

Por favor, hágame saber sus hallazgos.

- Mark as New

- Bookmark

- Subscribe

- Mute

- Subscribe to RSS Feed

- Permalink

- Report Inappropriate Content

¿Alguna idea sobre cómo importar un conjunto de datos grande con una conexión ODBC?

- Mark as New

- Bookmark

- Subscribe

- Mute

- Subscribe to RSS Feed

- Permalink

- Report Inappropriate Content

Hay varias estrategias que puede intentar para tratar con grandes conjuntos de datos en Power BI:

Utilice una conexión de consulta directa en lugar de importar los datos. Las conexiones de consulta directa permiten consultar los datos directamente desde la base de datos, en lugar de importarlos a Power BI. Esto puede ser más eficaz cuando se trabaja con conjuntos de datos grandes, ya que reduce la cantidad de datos que deben transferirse y almacenarse en Power BI. Sin embargo, también puede ser más lento, ya que las consultas se ejecutan en tiempo real y pueden requerir más recursos de la base de datos.

Utilice el muestreo de datos para reducir la cantidad de datos que se importan o consultan. El muestreo de datos permite seleccionar un subconjunto aleatorio de los datos que desea importar o consultar, en lugar de todo el conjunto de datos. Esto puede ser útil para probar y crear prototipos, ya que le permite trabajar con un conjunto de datos más pequeño y más manejable.

Utilice la actualización incremental para actualizar solo las filas nuevas o modificadas del conjunto de datos. La actualización incremental le permite configurar una programación para actualizar solo las filas que se han agregado o modificado desde la última actualización, en lugar de todo el conjunto de datos. Esto puede ser más eficaz cuando se trabaja con conjuntos de datos grandes que crecen con el tiempo, ya que reduce la cantidad de datos que deben procesarse y almacenarse en Power BI.

Utilice técnicas de modelado de datos para optimizar los datos para consultas y análisis. Las técnicas de modelado de datos, como la indización, la partición y los índices de almacén de columnas, pueden ayudar a mejorar el rendimiento de las consultas en conjuntos de datos grandes al optimizar la forma en que se almacenan y se accede a los datos.

- Mark as New

- Bookmark

- Subscribe

- Mute

- Subscribe to RSS Feed

- Permalink

- Report Inappropriate Content

Gracias por tu tiempo @DataSlayer , he probado todos los pasos que mencionas y esto no es lo que necesito.

1. La consulta directa no es una opción para ODBC.

2, 3,4. No es mi problema, quiero importar y cargar todos mis datos. La actualización incremental viene después de eso.

Helpful resources

Microsoft Fabric Learn Together

Covering the world! 9:00-10:30 AM Sydney, 4:00-5:30 PM CET (Paris/Berlin), 7:00-8:30 PM Mexico City

Power BI Monthly Update - April 2024

Check out the April 2024 Power BI update to learn about new features.

| User | Count |

|---|---|

| 2 | |

| 1 | |

| 1 | |

| 1 | |

| 1 |

| User | Count |

|---|---|

| 2 | |

| 2 | |

| 2 | |

| 2 | |

| 1 |